Algorithmus kombiniert Mobilitätsdaten autonomer Fahrzeuge

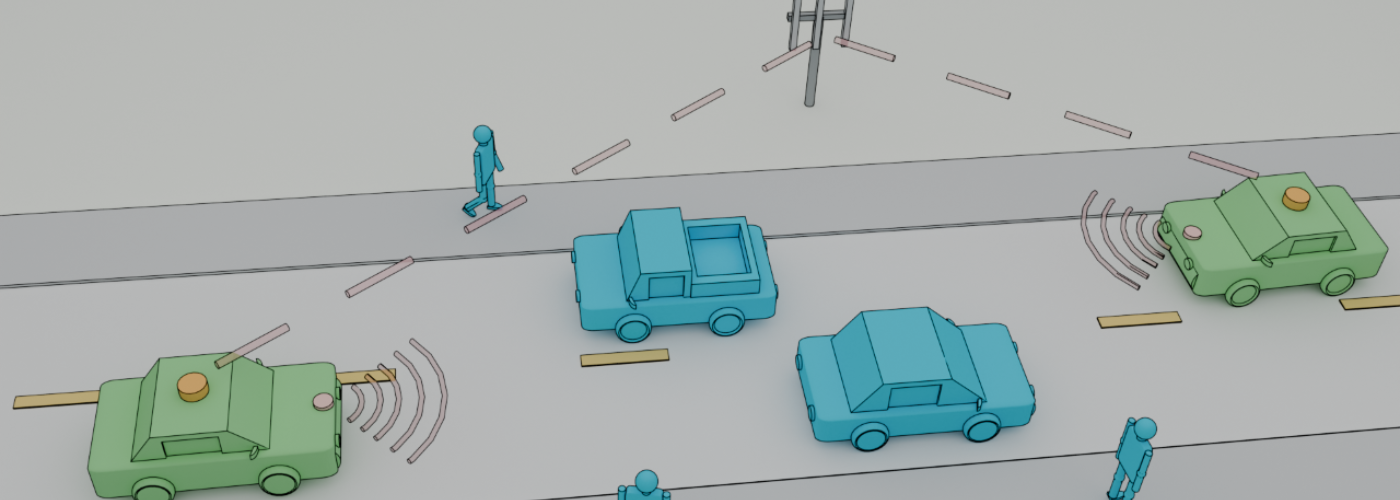

Autonome Fahrzeuge erfassen mithilfe eingebauter Sensoren Informationen über ihre Umgebung, um sich durch den Verkehr zu navigieren. Sie melden die Daten an Road Side Units, die Sensordaten aller Fahrzeuge kombinieren. Das Zukunftslabor Mobilität entwickelte einen Algorithmus, der die Datenverarbeitung unterstützt.

Die Mobilität der Zukunft wird sich durch vernetzte, intelligente und autonome Systeme auszeichnen. Erste Schritte auf dem Weg dahin sind bereits getan. Assistierende Fahrzeugfunktionen wie automatische Spurhalteassistenten oder der Tempomat gehören vielfach schon zum Standard. Auch Elemente des teilautomatisierten Fahrens wie das selbstständige Einparken eines PKWs sind keine Seltenheit mehr. Um eine vollständige autonome Mobilität umzusetzen – also, dass Fahrzeuge alle Verkehrssituationen komplett ohne menschliches Zutun fehlerfrei bewältigen – müssen allerdings noch wesentliche Konzepte und Technologien entwickelt werden.

Eine Voraussetzung für das autonome Fahren besteht darin, dass die Fahrzeuge ihr Umfeld erkennen und dementsprechend ihre Fahrmanöver anpassen. Mithilfe von Sensoren erstellen die Fahrzeuge ein sogenanntes Umfeldmodell, das u. a. Informationen über die Fahrspur, Verkehrszeichen sowie Position und Bewegung anderer Verkehrsteilnehmenden beinhaltet. Für die Erstellung eines solchen Umfeldmodells werden typischerweise mehrere verschiedene Sensortypen eingesetzt, da jeder Sensortyp gewisse Vor- und Nachteile mit sich bringt. Kameras sind z. B. sehr hoch auflösend und liefern wertvolle Farbinformationen. Bei schwierigen Licht- und Wetterverhältnissen sind Kameras jedoch eher problematisch. Laserscanner hingegen arbeiten weitgehend unabhängig von den Lichtverhältnissen, haben jedoch eine geringere Sensorauflösung und liefern keine Farbinformationen im Vergleich zu Kameras. Die Daten aus den einzelnen Sensoren werden im Fahrzeug zusammengeführt. Daraus entsteht das Umfeldmodell.

Das Umfeldmodell eines einzelnen Fahrzeuges ist typischerweise unvollständig und kann Fehler beinhalten. Denn die Sensordaten selbst sind mit Messfehlern behaftet. Außerdem hat ein einzelnes mit Sensoren ausgestattetes Fahrzeug grundsätzlich ein begrenztes Sichtfeld. Es kann z. B. nicht um die „Ecke“ oder durch das vorausfahrende Fahrzeug schauen. Mit dem Konzept der kollektiven Wahrnehmung wird dies behoben: Die Idee dahinter ist, dass die Fahrzeuge ihre Umfeldmodelle an eine zentrale Verarbeitungseinheit senden, die sogenannte Road Side Unit (RSU). In der RSU werden die einzelnen Umfeldmodelle zu einem einheitlichen globalen Umfeldmodell zusammengeführt bzw. fusioniert, das dann wiederum den Fahrzeugen bereitgestellt wird. Eine zentrale Herausforderung bei der Fusion verschiedener lokaler Umfeldmodelle ist die Zuordnung bzw. Assoziation von Objekten in den einzelnen Modellen.

Ein Beispiel: An einer Ampel steht ein autonomes Fahrzeug, das mithilfe seiner Sensoren zwei Fußgängerinnen und einen Radfahrer erkennt und in sein lokales Umfeldmodell einfügt. Nun fährt ein zweites Fahrzeug die Ampel an und erkennt mit seinen Sensoren lediglich eine Fußgängerin, d. h. sein lokales Umfeldmodell beinhaltet nur eine Fußgängerin. Für die Fusion dieser beiden Umfeldmodelle muss u. a. entschieden werden, welche der beiden Fußgängerinnen das zweite Fahrzeug erkannt hat, oder ob es sich sogar um eine dritte Fußgängerin handelt. Eine eindeutige Entscheidung ist aufgrund von Messfehlern der Sensoren oder fehlender Daten oftmals nicht möglich, sodass im Allgemeinen mehrere Möglichkeiten in Betracht kommen. Dieses Problem wird auch als Track-to-Track-Assoziation bezeichnet, d. h. Objekte aus verschiedenen Umfeldmodellen müssen in der RSU zugeordnet werden.

Bisherige Assoziationsverfahren – also Verfahren, die die identifizierten Objekte zuordnen – sind nicht für die Herausforderungen der kollektiven Wahrnehmung angepasst. Denn aufgrund der großen Anzahl an Sensoren und Verkehrsteilnehmenden kommen sehr viele Zuordnungsmöglichkeiten infrage. Daher entwickelten wir im Zukunftslabor Mobilität ein neues Assoziationsverfahren speziell für die kollektive Wahrnehmung.

Georg-August Universität Göttingen, Institut für Informatik

Entwicklung eines Assoziationsverfahrens für die kollektive Wahrnehmung

Bei dem Assoziationsverfahren handelt es sich um einen Algorithmus, der Techniken aus der stochastischen Optimierung verwendet. Der Algorithmus startet zunächst mit einer möglichen Zuordnung der Objekte. Diese Zuordnung wird nach bestimmten Regeln zufällig verändert, sodass der Algorithmus eine andere Zuordnung in Betracht zieht. Dieser Vorgang wird mehrfach wiederholt, sodass man sich der Lösung Schritt für Schritt annähert. Die Regeln, nach denen die Zuordnung zufällig verändert wird, haben die Wissenschaftler*innen ebenfalls ausgearbeitet. Das entwickelte Assoziationsverfahren ermöglicht es, die Objekte in Echtzeit zuzuordnen. Die Echtzeitassoziation ist zentral, um autonomes Fahren zu realisieren. Nur wenn die Informationen zügig verarbeitet werden, wird ein flüssiger Verkehr möglich. Die Berechnungen des Algorithmus erfolgen in der RSU, nicht in den einzelnen Fahrzeugen.

Virtuelles Testen des entwickelten Verfahrens

Um das entwickelte Assoziationsverfahren zu testen, simulierten die Wissenschaftler*innen ein Kreuzungsszenario mit zahlreichen Fahrzeugen, Fußgänger*innen und Fahrradfahrer*innen. Die virtuellen Fahrzeuge erfassten die Objekte in ihrer Umgebung mithilfe von Sensoren und erstellten Umfeldmodelle, die sie an die RSU schickten. Die RSU ordnete die erfassten Objekte auf Basis des entwickelten Assoziationsverfahrens zu. Die Simulation zeigte, dass das Verfahren effizient die wahrscheinlichsten Assoziationshypothesen zur Fusion der Umfeldmodelle bestimmen kann und sich daher besonders für die kollektive Wahrnehmung eignet.

Ausblick

Die Wissenschaftler*innen werden untersuchen, wie sich die Kommunikation zwischen den Fahrzeugen auf die Assoziation erfasster Objekte auswirkt. Ein Beispiel: Wenn die Fahrzeuge stets das gesamte Umfeldmodell an die RSU senden, entstehen riesige Datenmengen, die eine große Internetbandbreite erfordern. Denn bei jedem Umfeldmodell werden feste Konstanten wie Ampeln, Verkehrszeichen oder die Fahrspur erfasst. Sinnvoller wäre es stattdessen, dass die Fahrzeuge lediglich Veränderungen an die RSU weiterleiten, z. B. dass sich ein neuer Radfahrer in der Umgebung befindet. Das würde die Datenmenge reduzieren. Darüber hinaus werden sich die Wissenschaftler*innen damit beschäftigen, wie mit Störungen in der Kommunikation umzugehen ist, z. B. durch Verdeckungen.